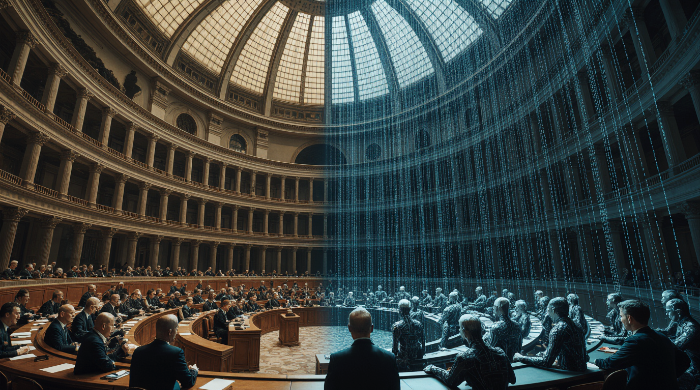

AI와 자유 의지 는 인간의 선택이 기술에 의해 얼마나 영향을 받는지 탐구합니다. 예측 모델, 대화 유도 논란, 그리고 자유 의지의 철학적 조건을 분석합니다. AI는 우리의 선택을 예측할 수 있지만, 대신 선택해 줄 수는 없다. 우리가 원하는 선택은 정말 우리의 것인가AI가 대화의 흐름을 예측하고, 우리의 취향을 파악하며, 다음 행동을 정확히 맞히는 시대가 되었습니다. 추천 알고리즘은 우리가 무엇을 볼지, 무엇을 살지, 누구를 만날지까지 결정하는 듯 보입니다. 그래서 질문은 자연스럽게 떠오릅니다. “우리는 여전히 자유롭게 선택하고 있는가?” AI 예측 모델의 구조 — 자유 의지가 아닌 확률의 문제딥러닝의 예측 원리AI는 사용자의 과거 기록, 언어패턴, 행동 데이터를 기반으로 가장 높은 확률의 반응을..