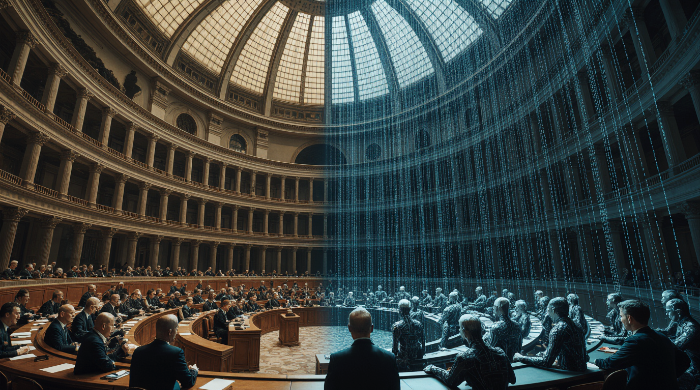

AI와 가치 판단 | 가치를 평가하는가, 재현하는가AI와 가치 판단 은 인공지능이 실제로 가치를 평가할 수 있는지, 아니면 학습된 패턴을 재현할 뿐인지 기술·철학적으로 분석합니다. LLM 구조, 가치 정렬 문제, 비트겐슈타인·데리다 사상을 함께 다룹니다. AI는 가치에 대해 말할 수 있지만, 가치를 ‘가질’ 수는 없다. 서론 — 가치는 데이터로 환원되지 않는다인간은 규칙을 적용하듯 가치 판단을 하지 않습니다. 가치는 경험, 상처, 공감, 문화적 기억, 그리고 스스로의 삶의 서사 속에서 형성됩니다. 반면 AI는 수십억 개의 텍스트를 학습하고, 가장 자연스럽고 빈도가 높은 패턴을 추출해 문장을 생성합니다.최근 AI가 도덕적으로 보이는 응답을 내놓으면서 중요한 질문이 떠오릅니다. “AI는 가치를 스스로 평..