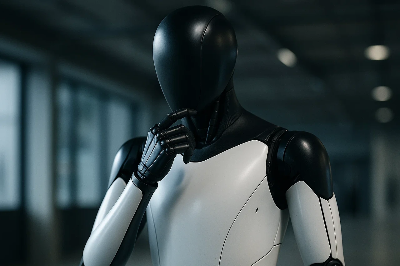

AI와 윤리는 기술의 문제가 아니라 인간성의 문제입니다. 책임, 공정, 자비를 탐구하며 인류의 도덕이 자동화될 수 없는 이유를 묻습니다. 서론인공지능은 인간에게 신과 같은 능력을 주었습니다 — 예측하고, 판단하며, 창조할 수 있는 힘. 그러나 그 힘은 하나의 질문을 남깁니다.“책임은 누구의 것인가?”자율주행차가 두 생명 중 하나를 선택해야 할 때, AI 채용 알고리즘이 성별이나 인종에 따라 차별할 때, 언어 모델이 잘못된 정보를 퍼뜨릴 때, 책임은 어디서 시작되고 어디서 끝나는가?기계가 행동할 수 있다면, 그 또한 책임질 수 있을까?혹은, 결국 책임은 코드를 만든 인간에게로 돌아오는가? 정의와 범위AI 윤리는 인공지능의 설계와 활용 과정에서 도덕적 가치, 인권, 사회적 책임을 다루는 학문입니다. 투명성..